摘要:在深度学习中,处理多个Loss的平衡至关重要。每个Loss函数衡量模型预测的不同方面的误差,因此需要在训练过程中妥善平衡它们。这通常通过调整每个Loss的权重来实现,也可能涉及优化器的选择和超参数调整。平衡多个Loss有助于提高模型的总体性能,使其在各种任务中表现更出色。

本文目录导读:

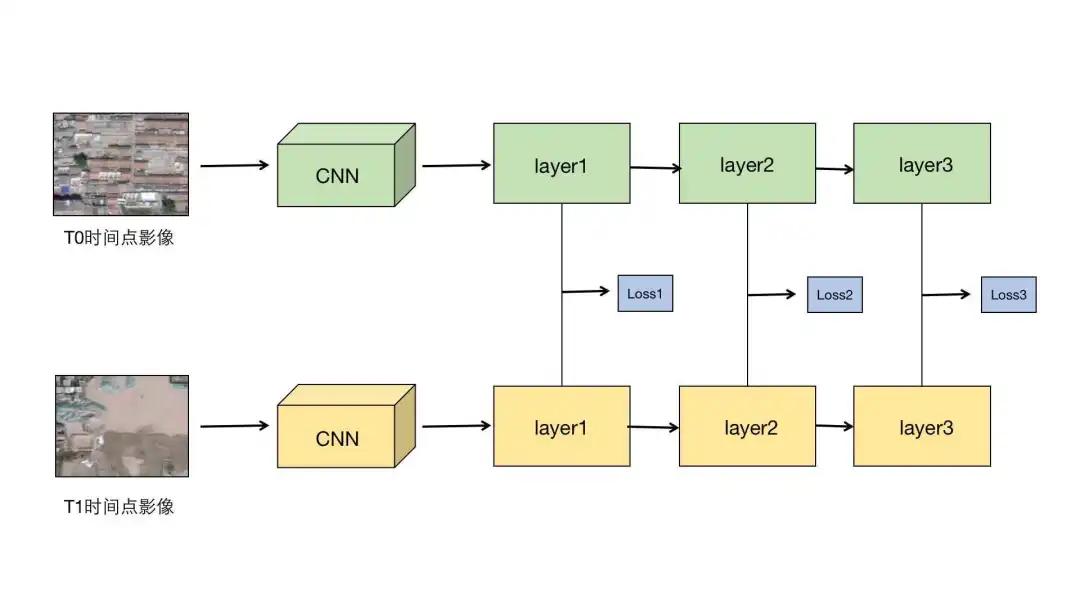

在深度学习中,我们经常遇到多任务学习(Multi-task Learning)的场景,即一个模型需要同时处理多个不同的任务,每个任务对应一个损失函数(Loss),如何平衡这些损失,使得模型在各项任务上都能取得良好的性能,是一个重要的问题,本文将探讨深度学习中多个Loss的平衡策略。

深度学习中多个Loss的来源

深度学习中多个Loss的来源主要有两个方面:一是多任务学习场景,二是复杂模型的输出预测与真实标签之间存在多种误差类型,在多任务学习场景中,每个任务都有其特定的目标,因此每个任务都需要一个独立的损失函数来衡量模型的预测结果与真实标签之间的差距,在复杂模型中,模型的输出可能与真实标签之间存在多种类型的误差,因此需要使用不同类型的损失函数来度量这些误差。

多个Loss的平衡策略

在深度学习中,平衡多个Loss的策略主要有以下几种:

1、权重法(Weighted Summation)

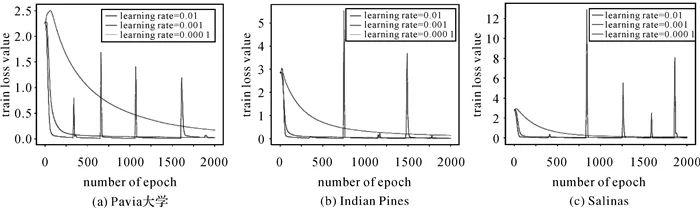

权重法是一种简单而常用的平衡策略,通过对每个损失函数分配一个权重系数,将多个损失加权求和,得到一个总损失,权重系数的选择需要根据任务的复杂性和重要性来确定,对于较为重要的任务或难以学习的任务,可以赋予较大的权重,这种方法的优点是简单直观,但权重系数的选择需要一定的经验和实验验证。

2、梯度法(Gradient Manipulation)

梯度法通过调整不同任务的梯度大小和方向来实现多个Loss的平衡,在反向传播过程中,可以根据任务的难易程度和重要性,调整对应任务的梯度大小或方向,对于难以学习的任务,可以增大其梯度,使其在网络优化过程中占据更大的比重,这种方法的优点是能够动态地调整不同任务的梯度,但需要对梯度操作有一定的理解和技巧。

3、动态权重调整法(Dynamic Weight Adjustment)

动态权重调整法是一种根据模型的表现动态调整不同任务权重的方法,在训练过程中,根据模型在不同任务上的表现,动态调整任务的权重系数,表现较差的任务在后续训练中会得到更大的权重,从而加大其在优化过程中的比重,这种方法的优点是能根据模型的表现自适应地调整任务权重,但需要设计合理的权重调整策略。

实际应用中的注意事项

在平衡多个Loss时,需要注意以下几点:

1、任务间的相关性:不同任务之间可能存在相关性,需要充分考虑任务间的相互影响,在设计和调整损失函数时,应考虑到任务间的关联性,避免任务间的冲突和干扰。

2、数据分布:不同任务的数据分布可能对模型的训练产生影响,在平衡多个Loss时,需要考虑到数据分布的差异,避免某些任务的数据分布对模型训练产生过大的影响。

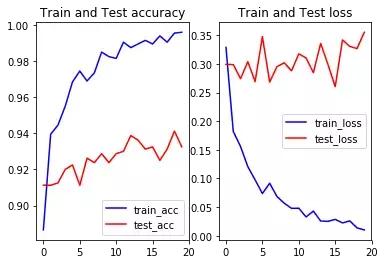

3、模型复杂度:模型的复杂度对多个Loss的平衡也有影响,过于复杂的模型可能导致过拟合,使得某些任务的损失无法有效优化,在设计和训练模型时,需要保持模型的复杂度与任务的复杂性相匹配。

深度学习中多个Loss的平衡是一个重要的问题,通过合理的平衡策略,可以使模型在各项任务上都能取得良好的性能,本文介绍了权重法、梯度法和动态权重调整法等几种常用的平衡策略,并讨论了实际应用中的注意事项,在实际应用中,需要根据具体的任务和模型特点选择合适的平衡策略,以达到最佳的模型性能。

粤ICP备19126298号

粤ICP备19126298号